2026年4月8日 北京时间

原标题参考:AI分身助手核心技术深度解析:2026年4月必学的智能体(Agent)全链路知识图谱

当AI不再只是“对话”,而是能够自主规划、调用工具、记忆历史的“分身助手”时,技术学习者面临的挑战已从“会用大模型”升级为“真正理解智能体”。

进入2026年,行业共识已达成:AI不再是查资料的引擎,而是具备行动能力的智能体(AI Agent)-2。许多开发者和面试备考者依然停留在“只会写提示词”的阶段——能调通API,却说不出大模型(LLM,Large Language Model)与智能体的本质区别;能用LangChain搭建demo,却理不清规划(Planning)、记忆(Memory)、工具调用(Tool Use)之间的协同逻辑。本文将以AI分身助手为线索,从痛点切入,拆解核心概念、展示可运行的代码示例、剖析底层原理,并提供高频面试题参考答案,帮助读者在2026年这一AI智能体元年完成从“会用”到“懂原理”的知识跨越-2。

本文整体结构分为六个板块:痛点切入(为什么需要AI分身助手)→ 核心概念(大模型与智能体的定义与关系)→ 关联概念(RAG与Function Calling详解)→ 概念关系总结→ 代码与流程示例→ 底层原理与面试考点。建议按顺序阅读,逐层递进。

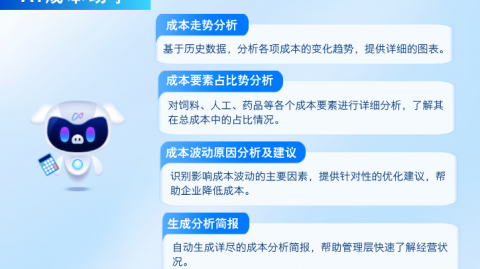

一、痛点切入:为什么需要AI分身助手?

传统方式:纯Prompt的局限

在AI分身助手出现之前,开发者与用户主要依赖“聊天机器人(Chatbot)”模式——靠提示词工程(Prompt Engineering)驯服模型-10。一个典型的使用方式是:用户输入问题 → 大模型直接生成文本回复。

传统Chatbot调用方式(仅对话) import openai response = openai.ChatCompletion.create( model="gpt-4", messages=[{"role": "user", "content": "北京今天天气怎么样?"}] ) print(response.choices[0].message.content) 模型只能凭训练知识"猜测"答案

这段代码看似“能用”,但暴露了传统方案的三大核心痛点:

痛点一:无法获取实时数据。 大模型的训练知识截止于某个时间点,无法主动获取实时信息(如当前天气、股票价格)。遇到“今天天气”这类问题,模型要么“编造”答案,要么依赖训练数据中的历史信息-。

痛点二:无法执行真实操作。 大模型能告诉你最完美的旅行方案,却没有办法去订一张机票-28。它本质上是知识丰富的聊天者,只“说”不做。

痛点三:多轮任务易“失忆”。 在跨会话或长周期任务中,模型缺乏持久的长期记忆,每次对话都像“金鱼脑”,无法记住用户偏好和历史交互-。

从Chatbot到Agent的范式跃迁

正是在这样的背景下,AI分身助手(即智能体Agent) 应运而生。如果说2023年是“聊天机器人”的元年,那么2026年则被公认为“AI智能体(Agent)元年”-10-2。分身助手的出现,标志着AI从“被动响应”向“主动执行”的质变:它不只是回答问题,而是拥有感知、记忆、规划和执行能力的独立单元-1。

二、核心概念讲解:大模型(LLM)与AI分身助手(Agent)

2.1 大模型(LLM,Large Language Model)

标准定义:大语言模型是基于Transformer架构、通过海量文本数据预训练得到的深度学习模型,具备语言理解、逻辑推理和文本生成的能力。

关键词拆解:“大”体现在参数量巨大(通常数十亿到数万亿),“语言模型”意味着它以自然语言为核心交互媒介。

生活化类比:大模型就像是AI分身助手的 “大脑” ——它负责听懂指令、思考问题、生成计划,但光有大脑还不够,没有手脚就无法真正做事-14。

2.2 AI分身助手(AI Agent / 智能体)

标准定义:AI Agent(Artificial Intelligence Agent,人工智能智能体)是在大模型基础上,整合了规划(Planning)、记忆(Memory)和工具使用(Tool Use)能力的自主系统,能够感知环境、制定计划并执行行动以达成目标--2。

核心公式:

Agent = LLM + Planning + Memory + Tool Use-2

规划(Planning) :将复杂目标自动拆解为可执行的子任务-1。

记忆(Memory) :通过RAG等技术保留长期知识和个人偏好-1。

工具使用(Tool Use) :自主判断何时调用API、操作外部软件或发送邮件-1。

价值所在:没有大模型,智能体只是死板的脚本;没有智能体,大模型只是无法触达业务实体的“缸中之脑”-14。据IDC 2025年末调研,虽然90%的企业部署了大模型,但仅有15%真正实现了业务自动化——而这15%的领先者全部采用了“智能体化”架构-14。

三、关联概念讲解:RAG与Function Calling

3.1 RAG(Retrieval-Augmented Generation,检索增强生成)

RAG是一种通过从外部知识库检索相关信息来增强大模型生成质量的技术架构。它将生成与可验证、可更新的证据紧密结合,让大模型能“查资料”后再回答-。

工作流程:用户提问 → 从向量数据库检索相关文档片段 → 将片段拼接进提示词 → 大模型生成基于检索结果的答案。

在AI分身助手中的作用:RAG是实现长期记忆的核心技术之一-1。你的数字分身可以通过RAG永久保留个人偏好、工作习惯和知识体系,实现跨会话的“记忆”。

3.2 Function Calling(函数调用)

Function Calling是大模型的一项革新能力,它允许模型在理解用户意图后,以结构化格式请求调用外部函数,从而解锁大语言模型的“实际行动力”-28。

工作流程:

声明:开发者提前向模型注册可用函数列表(名称、描述、参数结构)。

决策:模型解析用户意图,判断是否需要调用函数,并生成包含

function_call信息的JSON。执行:开发者执行真实函数(API调用/数据库查询),将结果返回模型。

回复:模型整合执行结果,生成自然语言回复-28。

在AI分身助手中的作用:Function Calling是实现工具使用的直接手段。数字分身通过它来联动API,打通办公软件、智能家居与外部服务,实现跨平台的闭环操作-1。

四、概念关系与区别总结

| 概念 | 本质定位 | 在AI分身助手中的角色 |

|---|---|---|

| 大模型(LLM) | 通用智力引擎(大脑) | 提供理解、推理、生成能力 |

| AI分身助手(Agent) | 自主执行系统(全身) | 整合规划+记忆+工具,达成目标 |

| RAG | 知识增强机制 | 实现长期记忆的技术手段 |

| Function Calling | 工具调用机制 | 实现工具使用的技术手段 |

一句话概括:AI分身助手是“整体架构”,大模型是其“核心大脑”,RAG和Function Calling分别是实现“记忆”与“工具使用”的具体技术路径。

对比理解:大模型是“知识丰富的聊天者”,AI分身助手是“既能思考又能行动的智能体”。前者只能“说”,后者能够“想”+“做”。

五、代码/流程示例演示

5.1 环境准备

安装依赖(基于LangGraph框架) pip install langgraph langchain-openai duckduckgo-search import os from typing import List, Annotated from langgraph.graph import StateGraph, END from langgraph.prebuilt import ToolNode from langchain_core.tools import tool from langchain_openai import ChatOpenAI

5.2 定义工具集

工具1:计算器 @tool def calculator(a: float, b: float, op: str = "add") -> float: """执行基础算术运算。op可选: add, sub, mul, div""" if op == "add": return a + b if op == "sub": return a - b if op == "mul": return a b if op == "div": return a / b raise ValueError("不支持的操作符") 工具2:模拟天气查询 @tool def get_weather(city: str) -> str: """获取指定城市的实时天气(模拟API调用)""" 真实场景中此处调用天气API weather_db = {"北京": "晴, 22°C", "上海": "多云, 20°C", "深圳": "阵雨, 25°C"} return weather_db.get(city, f"未找到{city}的天气数据") 工具列表 tools = [calculator, get_weather]

关键注解说明:@tool装饰器将普通Python函数注册为大模型可理解的工具。函数名、文档字符串(docstring)和参数签名共同构成了工具描述,大模型据此判断何时调用哪个工具。

5.3 构建智能体(AI分身助手)

初始化大模型(作为Agent的"大脑") llm = ChatOpenAI(model="gpt-4", temperature=0) 将工具绑定到模型,使模型具备"调用工具"的能力 llm_with_tools = llm.bind_tools(tools) 定义状态结构 class AgentState(TypedDict): messages: Annotated[List[dict], "对话历史"] steps: int 记录已执行步骤数 构建Graph(任务编排图) graph_builder = StateGraph(AgentState) 添加节点 graph_builder.add_node("agent", llm_with_tools) 推理决策节点 graph_builder.add_node("tools", ToolNode(tools)) 工具执行节点 设置入口 graph_builder.set_entry_point("agent") 添加条件边:如果需要调用工具,进入tools节点;否则结束 graph_builder.add_conditional_edges( "agent", lambda state: "tools" if state["messages"][-1].tool_calls else END, ) 工具执行后返回agent节点,继续推理 graph_builder.add_edge("tools", "agent") 编译Graph agent = graph_builder.compile()

5.4 运行效果对比

传统方式(无Agent) :

纯大模型调用 response = llm.invoke("北京天气怎么样?帮我算一下 25 + 17") print(response.content) 输出:大模型可能"猜测"天气,可能"计算"25+17但不可靠

Agent方式(AI分身助手) :

Agent自动规划并调用工具 result = agent.invoke({ "messages": [{"role": "user", "content": "北京天气怎么样?帮我算一下 25 + 17"}] }) print(result["messages"][-1].content) 输出:会先调用get_weather获取实时天气,再调用calculator计算结果,最后整合回复

核心改进:Agent能够自动识别任务中需要外部信息/操作的部分,通过工具调用来获取实时数据,真正实现“思考 + 行动”的闭环,这正是AI分身助手区别于普通聊天机器人的本质所在。

六、底层原理与技术支撑点

6.1 工具调用(Function Calling)的底层机制

Function Calling并非魔法,其底层依赖于结构化输出技术。大模型在训练阶段被学习了大量包含函数调用格式的数据,推理时能够输出符合预定义JSON Schema的响应,而非自由文本--28。

6.2 智能体编排的底层支撑

LangGraph等编排框架的底层依赖有向图(Directed Graph) 结构。每个节点代表一个计算单元(如推理、工具调用),边代表状态流转路径。系统通过检查点(Checkpointer)机制实现状态持久化,支持断点续传和多轮记忆-10。

6.3 相关框架生态(了解即可,不展开)

LangChain:组件集成的胶水层,快速搭建原型-10

LangGraph:构建复杂、有状态、循环工作流的运行时环境-10

LlamaIndex:专注数据接入与RAG索引-

AutoGen:微软开源的多智能体协作框架-43

MCP(Model Context Protocol) :模型与工具解耦的标准协议,被誉为AI时代的“USB-C”接口-10

七、高频面试题与参考答案

Q1:什么是AI Agent(智能体)?它与普通大模型应用的核心区别是什么?

参考答案(建议背诵):

AI Agent(Artificial Intelligence Agent,人工智能智能体)是在大模型基础上整合了规划、记忆和工具调用能力的自主系统。其核心公式为 Agent = LLM + Planning + Memory + Tool Use。

与传统大模型应用(如Chatbot)的核心区别有三点:

自主性:Agent能动态生成解决方案,而非依赖预设规则;

多步推理:能将复杂目标自动拆解为可执行子任务并持续追踪进度;

工具使用:可主动调用外部API或操作软件,实现“知行合一”-61。

踩分点:公式、三个关键词(自主性/多步推理/工具使用)、与Chatbot的对比。

Q2:解释RAG的原理及其在Agent中的作用。

参考答案:

RAG(Retrieval-Augmented Generation,检索增强生成)是一种将信息检索与文本生成相结合的技术架构。其工作流程分三步:检索相关文档片段 → 将片段融入提示上下文 → 大模型生成基于检索结果的答案-。

在Agent中的作用是实现长期记忆:通过RAG,AI分身助手能保留用户的个人偏好、工作习惯和知识体系,实现跨会话的持久化记忆,避免“金鱼脑”问题-1。

踩分点:三步骤流程、与长期记忆的关联、解决实时性/知识更新的价值。

Q3:Function Calling的工作流程是什么?

参考答案:

Function Calling的工作流程分为五步:

声明:开发者向模型注册函数(名称、描述、参数Schema);

决策:模型解析用户意图,输出结构化

function_callJSON;解析:开发者解析JSON并执行对应函数;

反馈:将函数执行结果返回模型;

整合:模型生成自然语言回复-28。

踩分点:五步顺序、JSON结构、开发者-模型协作分工。

Q4:AI Agent开发中常用的编排框架有哪些?各有什么特点?

参考答案:

LangChain:生态最广,强调组件可组合性,适合快速原型开发-43。

LangGraph:基于图结构的有状态工作流编排,支持循环和分支-10。

LlamaIndex:专注数据接入与RAG索引,检索准确率较早期提升约35%-。

AutoGen:微软开源,面向多智能体协作与角色分工-43。

MCP:模型与工具解耦的标准协议,支持跨模型、跨设备动态集成-20。

踩分点:每个框架一句话定位、LangChain vs LlamaIndex的差异化对比。

八、结尾总结

核心知识点回顾

AI分身助手 ≠ 大模型:大模型是“大脑”,分身助手是“全身”,二者是依赖关系而非等同关系。

核心公式:Agent = LLM + Planning + Memory + Tool Use,四者缺一不可。

两大支撑技术:RAG实现长期记忆,Function Calling实现工具使用。

实践路径:通过LangGraph等编排框架,可将大模型 + 工具集组装为可运行的智能体。

进阶方向预告

本文聚焦于AI分身助手的单体智能体(Single Agent) 架构。下期将深入多智能体系统(Multi-Agent System,MAS) ,探讨多个Agent如何协同工作、分工协作,以及MCP、A2A(Agent-to-Agent)等标准化协议如何重塑AI生态-。敬请期待!

本文成文于2026年4月8日,引用的行业数据截至2026年初。随着AI智能体技术的飞速演进,建议读者持续关注最新框架更新与面试考点变化。