说实话,没踏入这行之前,我总觉得芯片这玩意儿离咱老百姓挺远的。直到上个月帮表哥的工厂找能跑AI的5G模块,我才算真正跟这玩意儿杠上了。表哥那厂子本来是做监控摄像头的,现在想搞点“智能分析”,就是那种摄像头直接能认出人脸、数清楚人数,不用啥都往云端发的玩意儿。这一搞不要紧,把我折腾得够呛,但也总算弄明白了现在圈子里头最火的那个词——

刚开始我傻乎乎的,直接跑去华强北那些柜台,张嘴就要“5G AI芯片”。那老板瞅我一眼,眼神里就写着俩字:“棒槌”。他丢给我一句:“后生仔,你要嘅系基带定系NPU啊?讲清楚啲啦!”(年轻人,你要的是基带还是NPU啊?说清楚点!)我当时就懵了,啥玩意儿?不都是芯片吗?

后来我才知道,现在的5G芯片早就不是以前那个只会拨号上网的“傻子”了。特别是进了2026年,你看那高通新出的X80,还有联发科的M80系列,里头都硬生生塞进去了一个专门的AI大脑,叫啥张量加速器 -1。那帮搞技术的说,这叫“AI原生”设计。啥意思呢?就是说这芯片自己会“想”事儿了。以前你拿着手机过高铁站,信号切换老卡,现在不用了,芯片自己根据你以前跑这段路的速度和习惯,提前就抱好了下一个基站的大腿 -1。

这就引出了第一个让我头疼的问题:这么好的东西,我去哪儿扒拉?

这时候,

我差点就踩坑里了。有一家自称“代理”的小公司,拍着胸脯说手里有某某大厂的AI算力模组,价格比同行低两成。我多了个心眼,拿着他们给的型号去问了一个搞硬件的老师傅。老师傅一看就乐了:“这型号明明是去年发布的纯通信模组,哪来的AI算力?就算硬跑AI模型,跑两分钟就过热降频,卡成PPT你信不信?”吓得我一激灵。真正的

后来我经人介绍,认识了个在深圳做技术型分销的老炮儿。他那公司不大,藏在车公庙一个老旧的工业区里,但墙上挂满了各种专利证书。他那句话点醒了我:“小弟,现在卖芯片,卖的不是料,是‘解药’。” 啥解药?就是给那些做产品的工程师“救命”的解药。

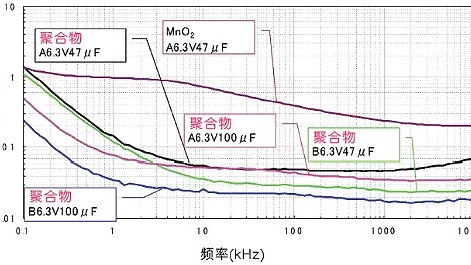

你想啊,现在的工程师做产品有多难?这就是圈里常说的“死亡三角”难题:想要信号好(5G带宽大),想要反应快(AI实时识别),还他妈想要省电(发热低) -1。这三个要求放一块儿,简直就是让马儿跑,又不让马儿吃草,还得马儿会算微积分。那咋办?就得靠芯片里的AI自己来协调。

我那哥们的公司,专门代理的就是能搞定这种“三角难题”的芯片。比如芯科科技的那个EFR32xG24系列,它里头有个叫MVP的专用核,专门跑AI的矩阵运算,比用主CPU跑快了8倍,关键是功耗只有原来的六分之一 -1。你听听,这才是核心价值!他们代理商要做的,不是光把芯片卖给做智能门锁的厂家,而是得告诉人家:“你那个门锁不是想做人脸识别吗?用这颗料,一节干电池撑一年,夜里黑乎乎也能认出是你二大爷,而不是隔壁那条狗。” 这就是本事。

那段时间我天天跟着他跑客户,有做AI玩具的,有做工业手持终端的,还有做人形机器人的。印象最深的是一个做机器人的团队,他们以前用的方案,主控芯片既要管走路平衡,又要管视觉识别,还得处理5G信号,结果就是机器人走着走着就“脑梗”了,站在原地发呆。我那哥们儿给他们推了移远通信基于高通平台做的那个SG885G模组,48T的算力 -1。最关键的是,他不仅是卖模组,还帮人家把机器人导航和关节控制的算法给预集成进去了。用那团队CTO的话说:“这哪是买芯片,这是买了个半个研发部啊!”

所以说,现在的代理,真不是简单的搬运工了。尤其是在AI和5G死死绑定的今天,代理手里得握着“弹药”,还得会教人怎么“打枪”。甚至有时候,你还得当“心理按摩师”。为啥?因为AI这玩意儿有个毛病——它不可解释。以前的通信网络,信号不好就是天线坏了或者遮挡了,逻辑很清楚。现在的AI网络,它会自己调波束、自己优化 -1。有时候信号突然好了,工程师不知道它为啥好;信号差了,也不知道它为啥差,干着急 -1。这时候代理就得出来安抚:“兄弟别慌,这是AI自己在深度学习,你让它再学两天,它就认识你家墙角的承重柱了。”

折腾了这一大圈,我算是真服了。在这个行当里,你想找个靠谱的ai5g芯片代理,就跟找对象一样,光看对方穿金戴银(价格低)不行,得看对方能不能跟你过日子,能不能帮你解决“生孩子”疼不疼(功耗高不高)、“孩子”聪不聪明(AI算力强不强)这些实际的问题。2026年了,5G-A都开始商用了,6G都在路上了 -8,芯片这东西,早就过了拼参数的蛮荒时代,现在是拼体验、拼智慧、拼谁能帮你把那个“不可能三角”给填平了的时代。找对了代理,你的产品就成功了一半;找错了,那就等着在“功耗墙”和“算力墙”之间撞得头破血流吧。

网友问答环节

网友“硬件攻城狮小Z”问:

“看了文章深有感触,最近我们在选型一个用于无人巡检小车的5G模组,要求低延迟图传+本地识别障碍物。市面上有的模块说带AI算力,有的说不带,价格差好多。想请教一下,怎么区分是真的‘内生AI’还是单纯的‘通信模组+外挂MCU’?如果预算有限,有必要硬上带AI的5G芯片吗?”

回答:

嘿,小Z兄嘚,你这问题问到点子上了,上个月我差点就在这上头交了学费。你这个问题其实圈里人叫“真假美猴王”鉴别题。怎么区分?你就死磕一个地方——物理层。真的“内生AI”芯片,比如现在高通的X80或者联发科的M80那一挂的,它的AI引擎是直接嵌在基带物理层(PHY)里的 -1。啥意思?就是你给信号解码的时候,AI就在旁边帮着算信道了,这种设计对降低延迟、省电效果贼明显。如果只是“外挂”,那通常是在主芯片旁边再单独放一颗小NPU或者MCU,这种方案虽然也能跑AI,但数据得在通信芯片和AI芯片之间倒腾一圈,就像谈恋爱还要通过中间人传话,延迟肯定大,功耗也下不来。

再教你个土办法,看参考设计。真正的AI 5G方案,代理商会给你看一整套的“软硬结合”的东西,比如直接帮你把障碍物识别的算法在模组上跑通给你看 -1。如果那个代理只是给你丢过来一张数据手册,让你自己看参数,你自己琢磨一下,这大概率就是卖通用件的。

至于预算有限要不要硬上?我的看法是,得看你产品的“灵魂”是啥。如果你的无人小车主要任务就是图传,把视频发回后台由人工或者服务器来分析障碍物,那纯5G模组就够。但如果你想让它自己有点“脑子”,万一信号不好或者云端抽风,它自己能紧急刹车,那这个本地AI算力就是保命钱,省不得。现在的趋势是,AI算力正在变成像电力一样的基础设施,省了这钱,可能明年你的产品就被淘汰了。

网友“华强北背包客阿强”问:

“兄弟,看你文章里提到在车公庙找的那个代理挺牛。我也是在华强北混的,手里有几个下游的组装厂客户,现在都想搞AIoT。我想拓展一下这方面的生意,但我就是个倒货的,不懂技术,那些原厂和大的代理也不太鸟我。像我这种小商家,如果想往‘AI5G芯片代理’这个方向靠,该从哪儿入手?总不能回学校重新学四年微电子吧?”

回答:

阿强,你这话让我想起我刚开始跑那会儿,也是一脸懵逼。别慌,咱不一定要变成科学家,但得变成“技术翻译”。你的优势在于手里有客户资源,懂他们的痛点和钱包厚度。你想转型,我给你指两条路,看你自己适合哪条。

第一,做 “场景化方案商” 。你先别盯着芯片型号,你坐下来跟你那几个组装厂客户喝顿酒,问问他们到底想做个啥AI产品?是做给老人用的AI陪伴娃娃?还是做养鸡场用的测温摄像头?问清楚了,你再去找你文章里提到的那种技术型代理,或者直接找移远、广和通这种大模组厂的业务员 -1。你就跟他们说:“我有客户要搞XX产品,需要多少算力,预算多少,你给配个套方案。” 他们最喜欢这种带着需求来的客户,会把参考设计、软件SDK都给你准备好。你要做的就是把这个打包的方案,加上你的服务费,再卖给下游工厂。这时候你卖的就不是芯片了,是“解决方案”,附加值立马就上来了。

第二,做 “特定行业的深挖” 。比如你就死磕“智能快递车”这一个领域。你把所有做无人配送车的企业都扒拉一遍,研究他们现在用的啥方案,有啥痛点(比如是不是经常在马路牙子边上信号断联?)。然后你拿着这个痛点,去找那些芯片原厂或者代理,比如去问问美格智能有没有针对车载低速场景优化的方案 -1。一旦你对这个行业的理解比原厂的销售还深,你就是不可替代的。

千万别想着去囤货,现在这行情,囤货死得快。要囤就囤“知识”和“人脉”。先让自己变得“值钱”,生意自然就来了。

网友“电信研究院老王”问:

“你好,我是做通信标准研究的。文中提到了AI辅助波束成形和信道估计,这些确实是3GPP Rel-18/19的热点。但从我们测试的角度看,AI引入后网络变得‘不可解释’,给一致性测试和互操作性测试带来了巨大挑战 -1。请问你在跟这些芯片代理或模组厂接触时,他们有没有透露过怎么解决‘AI黑盒’带来的测试认证问题?毕竟产品是要过入网测试的。”

回答:

王老师您好,您这个问题太专业了,确实是目前产业界的一个“隐痛”。我跟您分享一个我跟那个代理老炮儿去拜访一家做CPE厂商时听到的事儿。当时他们的测试工程师也在抱怨,说用了一颗带AI的芯片,OTA(空口)测试的时候,指标忽高忽低,因为AI自己在里头不断优化,导致测试环境不稳定。

您问他们怎么解决?据我观察,他们现在的思路是 “分层对待,局部透明”。什么意思呢?就是说,对于必须经过标准认证的基础通信功能(比如基本的信号发射、协议栈一致性),他们会通过软件或者硬件开关,暂时把AI的“自主决策”功能给旁路掉,或者锁定在某个标准配置模式下,用传统的测试方法去验证。保证最底层的通信链路是符合标准的,是“透明”的。

而对于那些AI增强的功能,比如动态优化的波束赋形、基于AI的信道估计,这部分目前还没有完全统一的国际测试标准,所以厂商更多的是采用 “场景化验证”+“厂商自声明” 的方式。就像是德科技那帮搞测量的也在推新的方法论,比如建立一个闭环的动态测试环境,让被测设备和模拟的真实环境互相博弈 -1。我听那代理老炮儿说,他们现在帮客户挑芯片,会特别看重原厂提供的 “AI模型可移植性”和“模型可量化评估”的能力。也就是说,你这个AI模型能不能在不同厂商的设备间通用?你的AI决策能不能用一些KPI指标(比如吞吐量提升多少,能耗降低多少)来量化证明 -1?只有能说清楚这个AI到底干了啥好事儿,花了多少代价,才能拿去跟入网测试的机构去沟通。这条路还很长,但大家都在摸着石头过河。